Khi GPU trở thành trái tim của trí tuệ nhân tạo

Trong thời đại công nghệ bùng nổ, trí tuệ nhân tạo (AI) đang dần trở thành trung tâm của mọi đổi mới – từ xe tự hành, nhận diện khuôn mặt đến các hệ thống ngôn ngữ tự nhiên như ChatGPT. Nhưng để AI có thể “học” và “suy nghĩ”, nó cần một bộ não phần cứng đủ mạnh để xử lý lượng dữ liệu khổng lồ. Và nhân vật chính đứng sau sức mạnh đó chính là GPU – Graphics Processing Unit. Từ vai trò ban đầu chỉ dùng để xử lý đồ họa, GPU nay đã trở thành trái tim của AI hiện đại.

GPU là gì và khác gì với CPU?

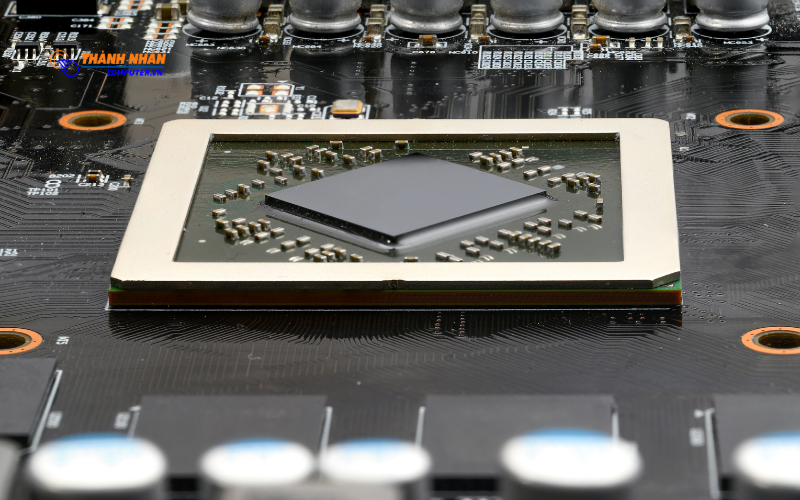

GPU, viết tắt của Graphics Processing Unit, là bộ xử lý đồ họa chuyên dụng, được thiết kế để thực hiện hàng nghìn phép tính song song cùng lúc. Ban đầu, GPU được phát triển nhằm tăng tốc quá trình hiển thị hình ảnh 3D trong game hoặc các phần mềm đồ họa. Tuy nhiên, với cấu trúc đặc biệt của mình, GPU nhanh chóng chứng minh rằng nó còn làm được nhiều hơn thế.

Trong khi CPU (Central Processing Unit) là bộ xử lý trung tâm, được tối ưu cho các tác vụ tuần tự, xử lý từng công việc một cách có trật tự, thì GPU lại khác. GPU có hàng ngàn lõi xử lý nhỏ, cho phép nó thực hiện cùng lúc rất nhiều phép toán. Chính đặc điểm này khiến GPU trở thành công cụ hoàn hảo cho việc huấn luyện các mô hình AI – nơi cần xử lý hàng tỷ phép tính ma trận và vector mỗi giây.

Vì sao AI cần GPU?

Hầu hết các thuật toán AI, đặc biệt là Machine Learning và Deep Learning, đều dựa trên việc xử lý ma trận (matrix computation). Trong quá trình “học”, mô hình phải tính toán hàng triệu trọng số (weights) và điều chỉnh chúng liên tục. CPU có thể làm điều này, nhưng tốc độ sẽ rất chậm vì nó chỉ xử lý từng lệnh một. Ngược lại, GPU có thể xử lý đồng thời hàng nghìn phép nhân – cộng ma trận, giúp rút ngắn thời gian huấn luyện mô hình từ hàng tuần xuống chỉ còn vài giờ.

Một ví dụ dễ thấy là khi huấn luyện mô hình GPT hoặc BERT trong xử lý ngôn ngữ tự nhiên (NLP). Những mô hình này chứa hàng trăm tỷ tham số. Nếu chỉ dùng CPU, quá trình huấn luyện có thể mất hàng tháng. Nhưng nhờ GPU, tốc độ được cải thiện hàng trăm lần, biến điều “không thể” thành “có thể”.

NVIDIA – người tiên phong đưa GPU vào thế giới AI

Trong suốt nhiều năm, NVIDIA là cái tên gắn liền với GPU và AI. Khi các nhà khoa học nhận ra khả năng tính toán song song của GPU phù hợp với huấn luyện mạng nơ-ron nhân tạo, NVIDIA đã nhanh chóng đầu tư phát triển kiến trúc GPU chuyên biệt cho AI. Năm 2012, khi mạng nơ-ron AlexNet chiến thắng cuộc thi ImageNet nhờ GPU, ngành AI chính thức bước vào kỷ nguyên tăng tốc.

Từ đó đến nay, các dòng GPU như NVIDIA Tesla, A100, H100 hay mới nhất là Blackwell đã trở thành nền tảng cho các trung tâm dữ liệu AI toàn cầu. Mỗi GPU có thể chứa hàng chục nghìn lõi CUDA, khả năng xử lý hàng nghìn tỷ phép tính mỗi giây (TFLOPS) và bộ nhớ băng thông cực cao. Nhờ đó, các công ty như OpenAI, Google hay Meta đều dựa vào hệ thống GPU để huấn luyện các mô hình ngôn ngữ khổng lồ.

GPU và vai trò trong huấn luyện mô hình AI

Huấn luyện AI giống như việc dạy một đứa trẻ học nói – cần dữ liệu, thời gian và khả năng tính toán. GPU đóng vai trò là “máy gia tốc” giúp AI học nhanh hơn. Quá trình này bao gồm ba bước chính:

1. Truyền dữ liệu (Data Feed): GPU nhận hàng terabyte dữ liệu từ ổ cứng hoặc bộ nhớ hệ thống. Nhờ khả năng truyền tải dữ liệu tốc độ cao, GPU giúp tránh tình trạng “nghẽn cổ chai”.

2. Xử lý tính toán (Computation): Mỗi phép nhân – cộng trong mạng nơ-ron được thực hiện song song. Một GPU hiện đại có thể xử lý hàng trăm triệu phép tính mỗi giây.

3. Tối ưu hóa (Optimization): GPU hỗ trợ quá trình lan truyền ngược (backpropagation), giúp mô hình điều chỉnh trọng số nhanh và chính xác.

Điều này lý giải vì sao mọi trung tâm dữ liệu AI ngày nay đều trang bị hàng nghìn GPU chạy song song. Thậm chí, các công ty lớn còn sử dụng cụm GPU (GPU cluster) để huấn luyện các mô hình khổng lồ – chẳng hạn như hệ thống DGX SuperPOD của NVIDIA có thể chứa hàng ngàn GPU liên kết với nhau thông qua mạng tốc độ cao.

GPU trong suy luận AI (Inference)

Không chỉ trong huấn luyện, GPU còn đóng vai trò lớn trong giai đoạn suy luận – khi AI “ra quyết định”. Mỗi khi bạn nhập câu hỏi vào chatbot hay AI nhận diện hình ảnh, GPU là thứ giúp hệ thống phản hồi trong tích tắc. Nó đảm bảo tốc độ xử lý nhanh mà vẫn giữ độ chính xác cao.

Ví dụ, các mô hình ngôn ngữ lớn như GPT-4 hoặc Claude chạy trên cụm GPU được tối ưu hóa cho inference. GPU đảm bảo quá trình sinh văn bản diễn ra mượt mà và tiết kiệm năng lượng hơn so với CPU truyền thống.

Sự cạnh tranh trong thị trường GPU cho AI

Thành công của NVIDIA khiến nhiều hãng khác không thể đứng ngoài cuộc. AMD với dòng GPU Instinct và Intel với Gaudi Accelerator đang nỗ lực chen chân vào thị trường. Ngoài ra, các công ty công nghệ lớn như Google, Amazon và Tesla cũng tự phát triển chip AI tùy chỉnh (AI accelerator) của riêng mình, chẳng hạn như Google TPU, Amazon Inferentia hay Tesla Dojo.

Dù vậy, GPU vẫn giữ vai trò trung tâm vì sự linh hoạt và khả năng hỗ trợ nhiều nền tảng AI khác nhau. GPU có thể dùng cho cả huấn luyện lẫn suy luận, từ phòng thí nghiệm nghiên cứu cho đến sản phẩm thương mại.

GPU và tương lai của phần cứng AI

Khi các mô hình AI ngày càng lớn, nhu cầu về hiệu năng cũng tăng theo cấp số nhân. Do đó, GPU tiếp tục được cải tiến mạnh mẽ về kiến trúc, tiêu thụ điện năng và khả năng kết nối. Thế hệ GPU mới như NVIDIA H100 hoặc Blackwell có thể kết hợp hàng trăm GPU trong cùng cụm, tạo ra sức mạnh tính toán ở mức siêu máy tính.

Bên cạnh đó, công nghệ mới như multi-GPU scaling và NVLink giúp các GPU giao tiếp nhanh hơn, xử lý khối lượng dữ liệu khổng lồ mà không bị nghẽn băng thông. Trong tương lai, GPU có thể được tích hợp sâu vào CPU (như xu hướng chip lai) để giảm độ trễ và tăng hiệu năng xử lý AI ngay trên thiết bị cá nhân – ví dụ như laptop AI hay smartphone AI.

GPU không chỉ dành cho AI

Mặc dù GPU đang là biểu tượng của AI, công nghệ này vẫn có vai trò rộng hơn nhiều. GPU còn được ứng dụng trong render video, thiết kế 3D, mô phỏng khoa học, blockchain và cả lĩnh vực y học tính toán. Sức mạnh xử lý song song khiến GPU trở thành công cụ không thể thiếu trong mọi ngành nghề cần tính toán hiệu năng cao.

Chẳng hạn, trong y học, GPU giúp mô phỏng cấu trúc protein nhanh hơn gấp hàng trăm lần, góp phần đẩy nhanh quá trình nghiên cứu thuốc. Trong thiên văn học, GPU giúp xử lý dữ liệu từ kính viễn vọng, tìm kiếm hành tinh và lỗ đen. Rõ ràng, tầm ảnh hưởng của GPU đã vượt xa ranh giới của thế giới đồ họa hay AI.

Thách thức và giới hạn của GPU

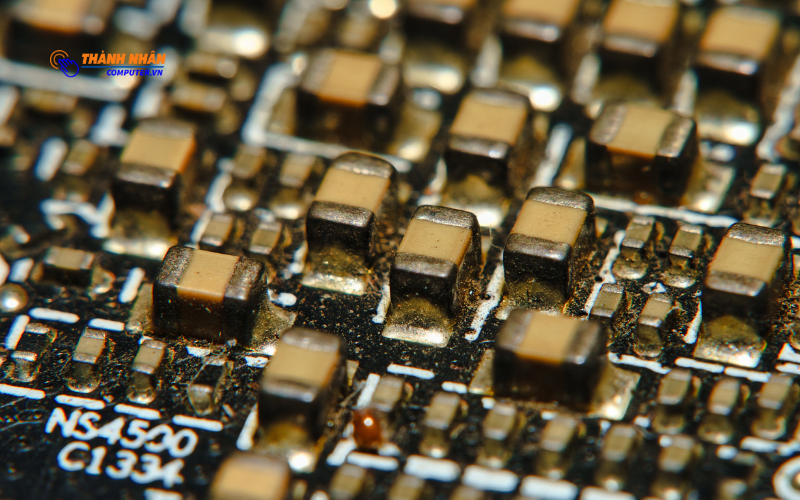

Dù mạnh mẽ, GPU cũng đối mặt với nhiều thách thức. Việc sản xuất GPU cao cấp yêu cầu dây chuyền bán dẫn tiên tiến (như 4nm hoặc 3nm), vốn chỉ một vài hãng như TSMC có thể thực hiện. Ngoài ra, GPU tiêu thụ lượng điện năng rất lớn và sinh nhiệt cao, đòi hỏi hệ thống làm mát phức tạp.

Chi phí cũng là vấn đề đáng kể. Một GPU AI cao cấp như NVIDIA H100 có giá hàng chục nghìn USD, khiến nhiều doanh nghiệp nhỏ khó tiếp cận. Do đó, xu hướng hiện nay là chia sẻ tài nguyên GPU qua đám mây (GPU Cloud), cho phép các công ty thuê sức mạnh xử lý mà không cần đầu tư phần cứng.

GPU – trái tim đang đập của kỷ nguyên AI

Từ một bộ xử lý đồ họa phục vụ game thủ, GPU đã trở thành trái tim của trí tuệ nhân tạo. Nó là công cụ giúp AI học nhanh hơn, suy nghĩ sâu hơn và phục vụ con người hiệu quả hơn. Trong bối cảnh AI len lỏi vào mọi lĩnh vực, từ y tế đến giáo dục và sản xuất, GPU không còn là phần cứng phụ trợ – nó chính là nền tảng cho tương lai số.

Như CPU từng là trung tâm của máy tính trong thế kỷ 20, thì GPU nay là trung tâm của thế kỷ 21 – nơi trí tuệ nhân tạo và sức mạnh tính toán hòa quyện để mở ra kỷ nguyên mới của đổi mới công nghệ.

- Hỗ trợ trả góp qua các hình thức:

- Hổ trợ trả góp HD Saison ( Chỉ cần CCCD gắn chip )

- Hỗ trợ trả góp lãi suất 0%. Hỗ trợ thanh toán mọi loại thẻ ghi nợ, thẻ tín dụng quốc tế (Visa, Master, JCB,..) và các thẻ ATM nội địa.

😎 😎QUÀ TẶNG TRÊN MỖI ĐƠN HÀNG 😎 😎

Tặng kèm Combo phím chuột văn phòng cao cấp

- Miễn phí vận chuyển – Miễn phí cài đặt phần mềm

- Tặng kèm gói vệ sinh miễn phí 12 tháng

- Tặng kèm lót chuột

Tin liên quan:

- Mối liên hệ giữa trí tuệ nhân tạo và sức mạnh phần cứng đồ họa

- Microsoft Excel - Sự tiến hóa từ bảng tính đơn thuần đến công cụ phân tích dữ liệu AI

Bình luận bài viết